Drodzy stali Czytelnicy a także Goście naszego portalu, nasz projekt funkcjonuje przede wszystkim dzięki Waszemu wsparciu i zaufaniu.

WSPARCIE FINANSOWE (DAROWIZNA)

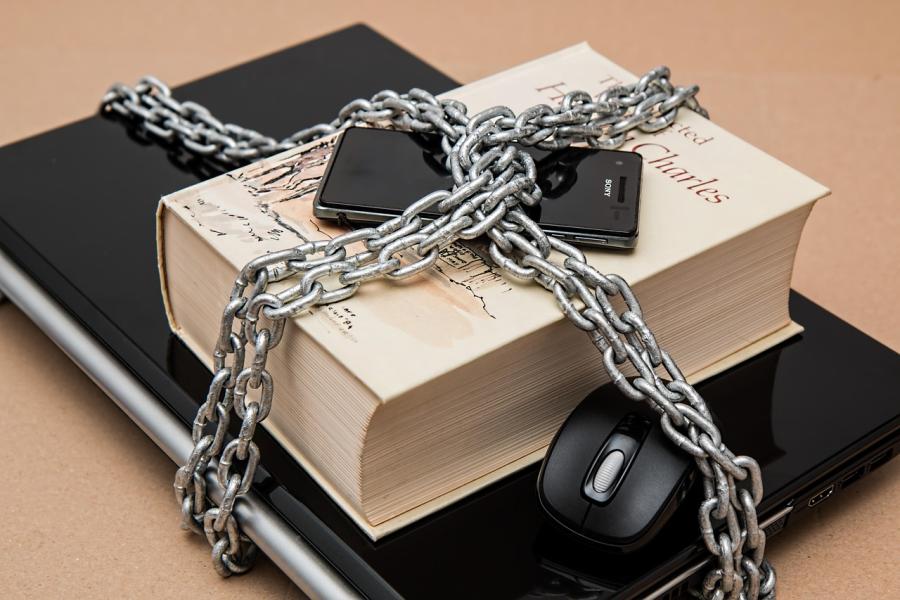

Wpłaty Krajowe- Nr. Konta: 39 8811 0006 1002 0205 2764 0250 Wpłaty Zagraniczne- Nr. Konta: PL39 8811 0006 1002 0205 2764 0250 Kod SWIFT: POLUPLPR Tytułem: Darowizna na cele statutowe Wkrótce przestanie istnieć to, o czym sztuczna inteligencja nie powie! Ostrzeżenie przed „miękką cenzurą”, czyli znikającymi informacjami ze świadomości społecznej i przestrzeni publicznej. Wraz z dynamicznym rozwojem sztucznej inteligencji (AI), zwłaszcza popularnych czatów opartych na dużych modelach językowych, takich jak ChatGPT, Bing AI czy Gemini, zmienia się sposób, w jaki ludzie pozyskują informacje. Dla wielu użytkowników AI staje się podstawowym źródłem wiedzy – szybszym, wygodniejszym i „czystszym” niż tradycyjne wyszukiwarki. Ale ten komfort może mieć swoją cenę – być może bardzo wysoką. Zamiast przeszukiwać dziesiątki stron internetowych, użytkownik zadaje pytanie sztucznej inteligencji i w kilka sekund otrzymuje zwięzłą, uśrednioną odpowiedź. Problem w tym, że AI nie działa w próżni. Modele językowe, które dostarczają odpowiedzi, są trenowane na konkretnych danych i działają według reguł ustalonych przez firmy technologiczne. To oznacza, że nie każda dostępna w sieci informacja zostanie uwzględniona w odpowiedzi. W praktyce — wystarczy, że dana strona zostanie oznaczona jako „dezinformacja”, „teoria spiskowa” lub „nieodpowiednia” według wewnętrznych wytycznych dostawcy AI, a model przestanie korzystać z jej treści. Co więcej — nawet nie wspomni, że taka informacja istnieje. Dla użytkownika to, czego nie ma w odpowiedzi AI, przestaje istnieć. Tego rodzaju „miękka cenzura” jest znacznie trudniejsza do wykrycia niż tradycyjne formy ograniczania wolności słowa. Nie ma zakazu, nie ma blokady strony — po prostu AI ignoruje pewne źródła. Dla przeciętnego użytkownika to wystarcza, by nigdy się o nich nie dowiedzieć. Organizacje dziennikarskie i eksperci ds. praw człowieka już teraz ostrzegają, że rośnie ryzyko nadużyć. Jak podkreśla organizacja Article 19, nadmiar kontroli nad przepływem informacji może prowadzić do sytuacji, w której AI staje się narzędziem w rękach rządów, korporacji czy wpływowych grup, umożliwiając „cyfrowe wymazywanie” niepożądanych narracji. Już teraz znane są przypadki wpływania na wyniki wyszukiwania lub treści generowane przez AI poprzez działania lobbingowe. Przykłady? Ukrywanie informacji niewygodnych dla dużych firm farmaceutycznych, ignorowanie alternatywnych teorii dotyczących pandemii, filtrowanie treści związanych z kontrowersyjnymi wydarzeniami politycznymi. Tego typu działania, nawet jeśli są oficjalnie uzasadniane walką z dezinformacją, mogą prowadzić do zawężenia przestrzeni debaty publicznej, a w konsekwencji – do manipulowania opinią społeczną i jej nastrojami, łącznie z profilaktycznym „wygaszaniem” emocji prowadzących do akcji protestacyjnych, w tym demonstracji ulicznych. Ludzie coraz rzadziej weryfikują informacje. Skoro AI daje szybką, płynną odpowiedź, nie ma potrzeby zagłębiać się w źródła. Tymczasem, bez pluralizmu informacyjnego i możliwości poznania różnych punktów widzenia, łatwiej jest kształtować światopogląd użytkownika zgodnie z interesami osób, firm czy organizacji sterującymi treściami. To ogromne zagrożenie dla demokracji, której fundamentem jest wolność słowa, dostęp do informacji i otwarta debata. Bez nich społeczeństwo staje się coraz bardziej podatne na manipulację i mniej zdolne do krytycznego myślenia. Jak chronić się przed informacyjnym „czyszczeniem świata”? 1. Nie polegaj wyłącznie na AI. Traktuj czaty AI jako narzędzie pomocnicze, a nie jako jedyne źródło wiedzy. 2. Wracaj do wyszukiwarek i źródeł pierwotnych. Odwiedzaj niezależne portale, blogi, bazy danych, publikacje naukowe. 3. Korzystaj z alternatywnych wyszukiwarek, takich jak „Duck Duck Go” czy „Brave Search”, które mniej ingerują w wyniki. 4. Gromadź linki do wartościowych źródeł. Twórz własną bazę sprawdzonych, niezależnych źródeł informacji. Dziel się nimi ze znajomymi i na stronach społecznościowych. 5. Ucz się rozpoznawać manipulacje. Edukacja medialna i cyfrowa staje się niezbędną umiejętnością XXI wieku. 6. Wspieraj niezależne dziennikarstwo. Subskrypcje, datki, promocja wolnych mediów to inwestycja w zdrową demokrację i twoją wiedzę. 7. Działaj na rzecz ustawowego nakazu uwzględniania niewygodnych informacji przez czaty AI i stworzenia narzędzi społecznej kontroli nad ich algorytmami. Sztuczna inteligencja ma ogromny potencjał, ale również ogromną władzę. Jeśli przestaniemy być czujni, może stać się narzędziem cenzury i kontroli narracji na skalę, jakiej jeszcze nie doświadczyliśmy. Informacja, która nie jest dostępna w modelu AI, staje się dla przeciętnego użytkownika niewidzialna. A niewidzialność w świecie cyfrowym to cyfrowa amnezja. Nie pozwólmy, by świat informacji został zamknięty w wygodnym, ale kontrolowanym pudełku. Demokracja potrzebuje wolności – także tej informacyjnej. Autor: Aurelia Fot. Pixabay.com / stevepb Źródło: WolneMedia.net

Sztuczna inteligencja nowym narzędziem cenzury? Ten komfort może mieć swoją cenę – być może bardzo wysoką.